人工知能(AI)、ビッグデータ法務

生成AIへのプロンプト入力時における個人情報保護法上の論点まとめ(前編)

生成AIへのプロンプト入力時に問題となる個人情報保護法の論点をまとめました。

本稿作成時点(2023年9月1日)における見解であり、今後、個情委が公表する内容等によって内容はアップデートする可能性がある点についてご留意ください。

Contents

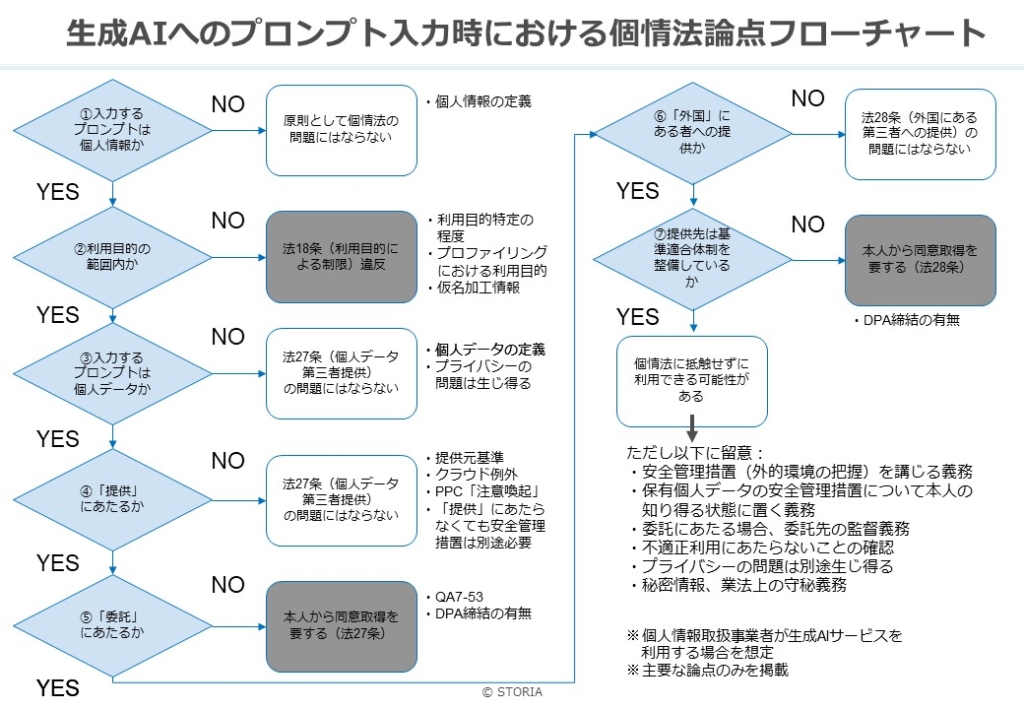

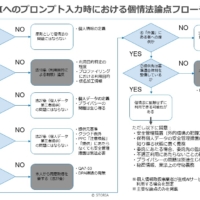

プロンプト入力時における個人情報保護法論点フローチャート

生成AIにプロンプトを入力するにあたり、個人情報保護法(個情法)上問題となり得る点をフローチャートにしてみました。

白色の帰結は、個情法に抵触せずに利用できる可能性が高い場合です。他方でグレーの帰結は、個情法に抵触するか(目的外利用)、本人(プロンプトに含まれる個人情報の主体)からの同意取得が必要になるため、適法に利用するためには一定の困難が生じる可能性がある場合です。以下、①から順番に解説していきます。

①入力するプロンプトは個人情報か

入力するプロンプトが個人情報にあたらなければ、原則として個情法の問題とはなりません1個人情報にあたらない場合であっても、個人関連情報にあたる場合等は一応個情法の問題となり得るため「原則として」としました。。

個情法における個人情報とは、シンプルに言うと、

生存する個人に関する情報であって、かつ、

①その情報に含まれる記述等によって特定の個人を識別できる情報(その情報単独で特定の個人を識別できる場合)

②他の情報と容易に照合できることによって特定の個人を識別できる情報(その情報単独では特定の個人を識別できないが、他の情報と容易に照合できることによって特定の個人を識別できる場合)

③個人識別符号を含む情報

のいずれかを指します(法2条1項)。

②利用目的の範囲内か

個人情報取扱事業者が個人情報を取り扱うにあたっては、利用目的をできる限り特定したうえで(法17条1項)、特定された利用目的の達成に必要な範囲で取り扱わなければなりません(法18条)。

ここにいう利用目的の特定とは、個々の取扱いプロセスごとに特定を求める趣旨ではなく、一連の取扱いにより最終的に達成しようとする目的の特定を求める趣旨です2園部逸夫=藤原靜雄 (編)『個人情報保護法の解説 第三次改訂版』(ぎょうせい、2022)147頁。もっともいわゆるプロファイリングを行う場合は、プロセスである分析行為の特定、すなわちいかなる情報を分析し、いかなる目的で分析結果を利用(提供)するかまでの特定を要します(GL通則編3-1-1)。利用目的の範囲を超える取扱いをする場合は、利用目的の変更(法17条2項)や、仮名加工情報や匿名加工情報への加工を検討することになります。

③入力するプロンプトは個人データか

個人データを第三者に提供する場合、原則としてあらかじめ本人の同意を得る必要があります(法27条1項)。個人データとは、個人情報データベース等を構成する個人情報を指します(法16条3項)。名刺を例にすると、散在する名刺の束は個人情報、これらの名刺をもとに特定の個人情報を検索できるように体系的に構成した名刺リストが個人情報データベース等、当該名刺リストを構成するレコードが個人データとなります。

個人データに当たらない個人情報(散在情報)の場合、第三者に提供するにあたって本人の同意を得る個情法上の義務はありません。もっともあくまで個情法上の義務がないにすぎず、本人の同意なく個人情報(散在情報)を第三者に提供(インターネット上での公開等含む)をすると、プライバシー侵害等の問題が生じる可能性がある点には注意を要します。

生成AIにおけるプロンプトが個人データにあたる場合とは、自社の従業員データベースや顧客データベースを構成する情報を入力する場合などが典型例となります。

④個人データの「提供」にあたるか(提供該当性)

入力するプロンプトが個人データにあたる場合であっても、「提供」したことにならなければ、第三者提供規制(法27条、法28条)は適用されません。そこでいかなる場合に「提供」したことになるのか(提供該当性)が問題となります。

クラウド例外(Q&A7-53)基準

いかなる場合が「提供」に該当するかについて、個情委は、「提供」とは個人データ等を自己以外の者が利用可能な状態に置くことを指すとしたうえで(GL通則編2-17)、クラウドサービスにおける「提供」の基準についてQ&A7-53で見解を示しています。重要なので全文を引用します(太字は筆者による)。

Q7-53

個人情報取扱事業者が、個人データを含む電子データを取り扱う情報システムに関して、クラウドサービス契約のように外部の事業者を活用している場合、個人データを第三者に提供したものとして、「本人の同意」(法第27条第1項柱書)を得る必要がありますか。または、「個人データの取扱いの全部又は一部を委託」(法第27条第5項第1号)しているものとして、法第25条に基づきクラウドサービス事業者を監督する必要がありますか。A7-53

クラウドサービスには多種多様な形態がありますが、クラウドサービスの利用が、本人の同意が必要な第三者提供(法第27条第1項)又は委託(法第27条第5項第1号)に該当するかどうかは、保存している電子データに個人データが含まれているかどうかではなく、クラウドサービスを提供する事業者において個人データを取り扱うこととなっているのかどうかが判断の基準となります。

当該クラウドサービス提供事業者が、当該個人データを取り扱わないこととなっている場合には、当該個人情報取扱事業者は個人データを提供したことにはならないため、「本人の同意」を得る必要はありません。

また、上述の場合は、個人データを提供したことにならないため、「個人データの取扱いの全部又は一部を委託することに伴って・・・提供される場合」(法第27条第5項第1号)にも該当せず、法第25条に基づきクラウドサービス事業者を監督する義務はありません。

当該クラウドサービス提供事業者が当該個人データを取り扱わないこととなっている場合の個人情報取扱事業者の安全管理措置の考え方についてはQ7-54参照。

当該クラウドサービス提供事業者が、当該個人データを取り扱わないこととなっている場合とは、契約条項によって当該外部事業者がサーバに保存された個人データを取り扱わない旨が定められており、適切にアクセス制御を行っている場合等が考えられます。

なお、法第28条との関係についてはQ12-3参照。

クラウド例外基準を厳格に解する立場と、弾力的に解する立場

このQ&A7-53が示す提供該当性の基準(いわゆる「クラウド例外基準」)の解釈については、厳格に解する立場と、ある程度弾力的に解する立場があり、実務上も見解が統一されていないのが現状と理解しています。

すなわち、厳格に解する立場は、Q&A7-53における「個人データを取り扱うこととなっているのかどうか」「契約条項によって…個人データを取り扱わない旨が定められており、適切にアクセス制御を行っている場合等」の文言を素直に解釈し、データの中身をサービス提供者が解析して処理結果をユーザーに戻すようなサービス(翻訳SaaSや契約書審査SaaSなど)はもちろん、インシデント発生等に限って例外的にアクセスする場合であっても、個人データを取り扱っているといえる以上は「提供」にあたると考えるものです。岡村久道著『個人情報保護法第4版』313頁はQ&A7-53の解釈について「個人データへのアクセスを①契約条項で禁止し、②当該データ内容を適正に暗号化するなどして判読不能にする必要があるという趣旨であろう」としており、厳格に解する立場といえます。

これに対し、ある程度弾力的に解する立場は、クラウドサービスの規約においてサーバ内のデータに一切アクセスしない旨が明記されていることは通常ないといった実情も踏まえたうえで、通常のサービス提供時は個人データにアクセスせず、インシデント発生等の例外的な場合に限ってアクセスされるような場合であれば、「個人データを取り扱わないこととなっている」場合にあたるとして「提供」に該当しないと考えるものです。

この解釈をとる場合、インシデント等の例外的なアクセスが許されることについては、Q&A7-53の「契約条項によって…個人データを取り扱わない旨が定められており、適切にアクセス制御を行っている場合等」の「等」に含めて解釈することになると思われます。岡田淳ほか「連載 個人情報保護をめぐる実務対応の最前線 第15回 AIと個人情報・プライバシー」(NBL1208号)52頁は、Q&A7-53の解釈について「通常のサービス提供の過程でクラウド事業者がサーバ内の個人データを取り扱わないことが前提となっているのであれば、原則として個人データの提供には該当しないと整理してよいのではないかと考える」としており、弾力的に解する立場といえます。

個人的には、「提供」にあたらない場合、個人データの第三者提供に関する法27条法28条の規律が適用されないこととなるほか、委託先の監督義務(法25条)も負わないことになることに鑑み、現時点における個情委の公表資料からは個情委はいずれの解釈をとっているのかは明確でない以上、提供該当性については厳格に解することがセーフティであると考える立場(厳格説)をとり、これまで実務に携わってきました。

もっとも厳格解釈と弾力的解釈いずれの立場をとる場合であっても、データの中身をサービス提供者が解析して処理結果をユーザーに戻すようなサービス(翻訳SaaSや契約書審査SaaSなど)については、現にデータの中身を処理・解析している以上は「個人データを取り扱うこととなっている」ものとして「提供」に該当する(そのうえで「委託」該当性を検討する)との考え方がほとんどであったと認識しています。

個情委による6月2日付「注意喚起」における基準

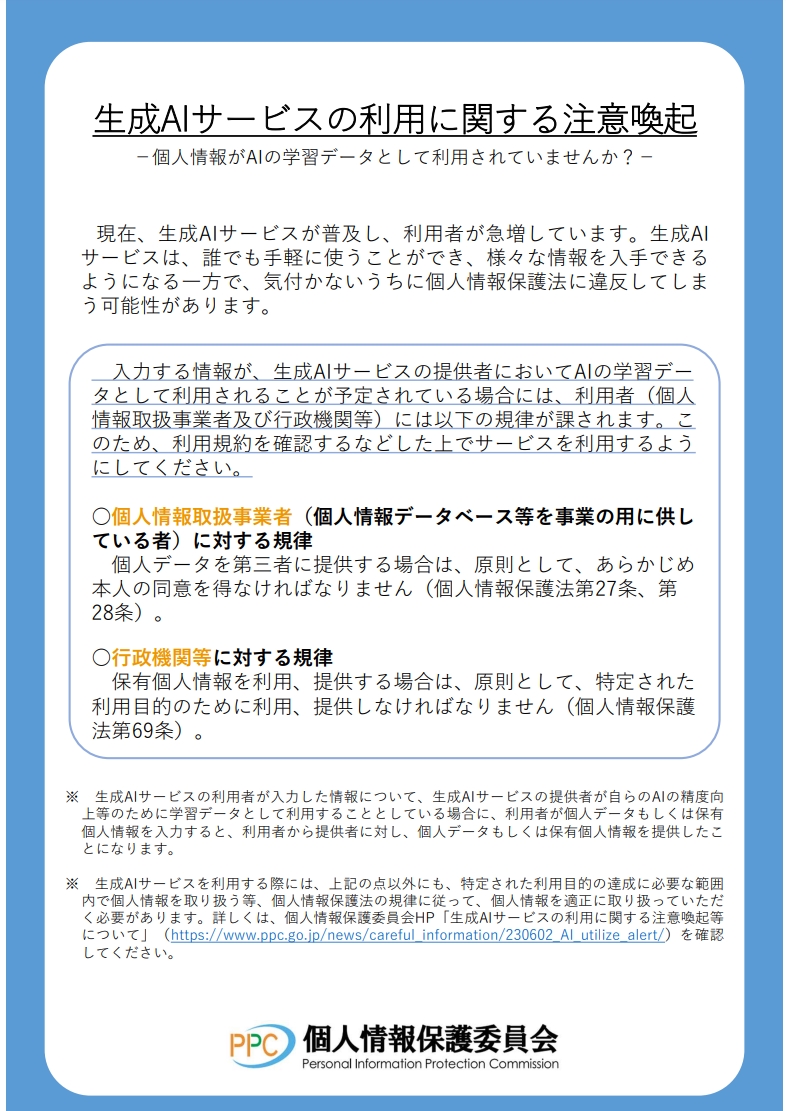

そうしたところ、2023年6月2日、個情委から「生成 AI サービスの利用に関する注意喚起等」(以下「注意喚起」)が公表されました(リンク)。関連する箇所(別添1(1)②)を以下に引用します。

注意喚起 別添1(1)

② 個人情報取扱事業者が、あらかじめ本人の同意を得ることなく生成AIサービスに個人データを含むプロンプトを入力し、当該個人データが当該プロンプトに対する応答結果の出力以外の目的で取り扱われる場合、当該個人情報取扱事業者は個人情報保護法の規定に違反することとなる可能性がある。

そのため、このようなプロンプトの入力を行う場合には、当該生成AIサービスを提供する事業者が、当該個人データを機械学習に利用しないこと等を十分に確認すること。

上記の注意喚起は、本人の同意なく個人データがプロンプトに対する応答結果の出力以外の目的で取り扱われる場合、個情法違反となる可能性を指摘するものですが、私はこの注意喚起は、生成AIサービスのプロンプト入力時における提供該当性について個情委が見解を示したものと理解しています。

なぜなら個情委は、注意喚起の公表後である本年8月21日、広報パンフレット「生成AIサービスの利用に関する注意喚起」を公表しているところ、このパンフは6月2日付注意喚起とほぼ同じ内容であり、注意喚起を分かりやすく説明するために作成されたドキュメントと位置づけられます。そしてパンフ下段では「※ 生成AIサービスの利用者が入力した情報について、生成AIサービスの提供者が自らのAIの精度向上等のために学習データとして利用することとしている場合に、利用者が個人データ…を入力すると、利用者から提供者に対し、個人データ…を提供したことになります。」と記載しており、この文言を素直に読めば、注意喚起パンフ及びその元となった注意喚起は、生成AIサービスのプロンプト入力時における提供該当性についての基準を示したものであると理解できるためです。

クラウド例外基準と注意喚起基準の関係をどう考えるか

注意喚起は、クラウド例外基準における「個人データを取り扱うこととなっているかどうか」ではなく、「プロンプトに対する応答結果の出力以外の目的で取り扱われるかどうか」を基準にしており、「提供」にあたる範囲を狭める解釈をとったようにみえます。そのうえで注意喚起は、「プロンプトに対する応答結果の出力以外の目的で取り扱われる」場合の具体例として「当該生成AIサービスを提供する事業者が、機械学習に利用すること等」を挙げていると読むことができます。

すなわち、注意喚起の基準からすれば、入力したプロンプトが、プロンプトに対する応答結果を出力する目的でのみ取り扱われる場合は「提供」にはあたらず、個人データの第三者提供規制(法27条や法28条)は適用されないと読むことができると考えます。

クラウド例外基準と注意喚起基準の関係をどう考えるかですが、

①説 生成AIサービスに限り、クラウド例外基準ではなく注意喚起基準が適用される(注意喚起はクラウド例外の例外)

②説 両者はそもそも同じ基準であった(注意喚起基準はクラウド例外基準を具体化したものに過ぎない)

の2通りの解釈があり得ると考えます。

クラウド例外基準(QA7-53)を厳格に解する立場をとり、QA7-53の文言を素直に読む場合は①説と親和性があります。すなわちクラウド例外基準における「取り扱うことになっている」にあたる場合であっても、「応答結果の出力目的でのみ取り扱われる場合」であれば、生成AIサービスに限っては「提供」にあたらない場合を認めたと考える、「注意喚起基準はクラウド例外の例外」と捉える考え方です(①説)。

これに対し、個情委はそもそもクラウド例外基準においても、通常のサービス提供の範囲で個人データを処理するような場合であれば「個人データを取り扱わないこととなっている場合」にあたるので提供に該当しないと整理しており、注意喚起基準における「応答結果の出力目的でのみ取り扱われる場合」は、クラウド例外基準を具体化したものに過ぎないとする考え方です(②説)。

個人的には、たとえ「応答結果の出力目的でのみ取り扱われる場合」であっても「取り扱っていること」には変わりがないこと、Q&Aにおいて個情委が保守サービス事業者の事例につき「提供」に当たる場合の具体例を挙げたQ&A7-55記載の内容は、②説とは矛盾するように思えることから、現時点では、私は両基準の整合性について①説(注意喚起基準は生成AIサービスに限ってクラウド例外基準の例外を認めた)と考えています。もっとも個情委がいずれの考え方なのか、あるいはいずれでもないのかは明らかでありません。

以上のとおり、クラウド例外基準と注意喚起基準の関係について現時点では明らかでないものの、少なくとも生成AIサービスのプロンプト入力時における提供該当性については、注意喚起基準、すなわち「プロンプトに対する応答結果の出力以外の目的で取り扱われるかどうか」を基準としてよいと考えます。

具体的な生成AIサービスへのあてはめ(ChatGPT Web版/API版/Enterprise版)

Chat GPT Web版

ChatGPTのWeb版の場合、Terms of useにおいて、入力されたデータについては、当社のサービスの開発および改善に役立てるために使用することがあると記載されています3 Terms of use3.(c) 2023年3月14日版“We may use Content from Services other than our API (“Non-API Content”) to help develop and improve our Services. ” https://openai.com/policies/terms-of-use。

ただしトレーニングをオフに設定するか、オプトアウト申請により、モデルのトレーニングのための会話の使用を拒否することができます4https://help.openai.com/en/articles/5722486-how-your-data-is-used-to-improve-model-performance。

Chat GPT API版

次にAPI経由で入力されたデータについては、モデルのトレーニングには使用しないと記載されています5https://openai.com/enterprise-privacy “Data from ChatGPT Enterprise and the API Platform (after March 1, 2023) isn’t used for training our models.”。ただし、API経由の場合であっても、(1)エンジニアリングサポート、潜在的なプラットフォーム不正使用の調査、および法令遵守のために権限を付与された従業員によってアクセスされる場合、および(2)機密保持義務およびセキュリティ義務に拘束される専門の第三者が不正使用や誤用がないかを確認するためにアクセスされる場合はあるとの記載があります6https://openai.com/enterprise-privacy “Access to API business data stored on our systems is limited to (1) authorized employees that require access for engineering support, investigating potential platform abuse, and legal compliance and (2) specialized third-party contractors who are bound by confidentiality and security obligations, solely to review for abuse and misuse.”。

ChatGPT Enterprise版

ChatGPT Enterpriseですが、こちらのFAQをみると、入出力データはトレーニングには絶対に使用しない(Absolutely not)とある一方で、OpenAIの従業員は、インシデントの解決や、ユーザーの明示的な許可によって会話を回復する場合、または法律で要求された場合は、データにアクセスできるとあります7https://openai.com/enterprise-privacy “Within your organization, only end users can view their conversations. Workspace admins have control over workspaces and access. Authorized OpenAI employees will only ever access your data for the purposes of resolving incidents, recovering end user conversations with your explicit permission, or where required by applicable law.”。

以上のとおり、ChatGPTの場合、Web版でトレーニングのために利用される場合はもちろん、API版であっても不正や誤用の調査目的で、Enterprise版であってもインシデントの解決目的等で、OpenAIの従業員等にアクセスされる可能性がある以上、いずれの場合であっても「応答結果の出力以外の目的で取り扱われる場合」には当たり得るものとして「提供」に該当する(そのうえで委託該当性や基準適合体制を満たすかについて検討する)と整理した方が、現時点ではセーフティであると考えます。

Azure OpenAI Service

Microsoftが提供するAzure OpenAI Serviceの場合、プロンプトや生成テキストは、不正監視目的で30日間保存されますが、一定の基準を満たせば、申請によって不正監視機能をオフにして、プロンプト及び生成コンテンツを保存しない扱いにできます8Data, privacy, and security for Azure OpenAI Service(2023/06/24)https://learn.microsoft.com/ja-jp/legal/cognitive-services/openai/data-privacy。

このように、Azure OpenAI Serviceで不正監視機能をオフにした場合であれば、「応答結果の出力以外の目的」では取り扱われないといってよく、「提供」にあたらないといえます。

「提供」にあたらない場合、法27条や法28条は適用されませんが、「提供」にあたらない場合であっても、サービスを利用する事業者は、自ら果たすべき安全管理措置の一環として適切な安全管理措置を講じる必要はあります(Q&A7-54)。

以上、本稿は前編として、プロンプト入力時における論点のうち①~④、特に④「提供」該当性について解説しました。次回は論点⑤以降を検討します(弁護士杉浦健二)。

- 1個人情報にあたらない場合であっても、個人関連情報にあたる場合等は一応個情法の問題となり得るため「原則として」としました。

- 2園部逸夫=藤原靜雄 (編)『個人情報保護法の解説 第三次改訂版』(ぎょうせい、2022)147頁

- 3Terms of use3.(c) 2023年3月14日版“We may use Content from Services other than our API (“Non-API Content”) to help develop and improve our Services. ” https://openai.com/policies/terms-of-use

- 4https://help.openai.com/en/articles/5722486-how-your-data-is-used-to-improve-model-performance

- 5https://openai.com/enterprise-privacy “Data from ChatGPT Enterprise and the API Platform (after March 1, 2023) isn’t used for training our models.”

- 6https://openai.com/enterprise-privacy “Access to API business data stored on our systems is limited to (1) authorized employees that require access for engineering support, investigating potential platform abuse, and legal compliance and (2) specialized third-party contractors who are bound by confidentiality and security obligations, solely to review for abuse and misuse.”

- 7https://openai.com/enterprise-privacy “Within your organization, only end users can view their conversations. Workspace admins have control over workspaces and access. Authorized OpenAI employees will only ever access your data for the purposes of resolving incidents, recovering end user conversations with your explicit permission, or where required by applicable law.”

- 8Data, privacy, and security for Azure OpenAI Service(2023/06/24)https://learn.microsoft.com/ja-jp/legal/cognitive-services/openai/data-privacy

STORIA法律事務所へのお問い合わせはこちらのお問い合わせフォームからお願いします。