人工知能(AI)、ビッグデータ法務

それ、本当に代理ですか?AIエージェントの法的位置づけ

はじめに

いわゆるAIエージェント1AIエージェントの定義は未だ確立していないものの、従前のAI技術と比較したAIエージェントの特徴として、殿村桂司、小松諒、松﨑由晃「AIエージェントに関する法的問題の考察(上)」NBL1292号(2025.6.15) 5頁では、①一定の目標に向けて、必要なタスクを自律的に判断する②選択した各タスクを実行する③実行した各タスクを評価し、自律的に修正・調整しながら目標達成に向けたタスクの実行を継続することを挙げており、実態にも沿っていると思われます。が行った取引の効果について、AIに法人格を付与し当該法人に取引効果を帰属させるべき、または、AIエージェントが行った行為を代理行為とみて、AI利用者2今後、本稿では「AI利用者」「AI提供者」「AI開発者」という言葉を特段の注釈なく用いますが、その定義は総務省・経済産業省「AI事業者ガイドライン 第1.1版」5頁に記されているところによります。である本人に効果を帰属させるべきとする議論3AIエージェントが産業ユースケースとして登場したのはここ数年ですが、この議論の歴史はそれよりも古く、1992年にLawrence B. Solum(現バージニア大学ロースクール教授)が行った問題提起に端を発します。哲学的・倫理的にAIに法的人格を付与してよいか、という非常に興味深い問があるのですが、本稿の趣旨とはズレますので割愛します。哲学的・倫理的な側面含めたこれまでの議論状況については、中川裕志「AIが法的人格を持つことの可否に関する研究動向」Information Network Law Review Vol. 24 (2025) 82頁以下に詳しく、義務論的な側面と帰結主義的な側面を区別して議論すべき旨を明快に指摘するものとして、大屋雄裕「AGIと社会と人類と」『情報通信政策研究』 第8巻第1号があります。なお、余談ですが、私は、哲学的・倫理的な理由でAIに対し法的人格を与えるべきではないという立場には立っていません。があります。

このような議論は、法哲学的議論・立法論としては傾聴に値する見解といえ、SF的な興味からも耳目を引きやすいものですが、私は、上記のような議論は全てのエージェントAIに妥当するものではなく、このような議論をする必要があるケースは限定的である4赤坂は、「AIに法的主体性を持たせるというアイデアは、今日の法制度で採用されているいくつかの法理を類推または応用することを超えるほどに意味があることなのだろうか」という問いを立てており、私も同様の問題意識を持っております。赤坂亮太「不法行為法におけるAIの法的人格に関する検討」人工知能学会全国大会論文集 第 32 回 (2018) 参照。と考えており、以下ではそのことについて少し述べます。

Contents

想定ケース

AIエージェントの利用者本人が「3月10日に品川駅近くのホテルを予約しておいて」などの大雑把な要請をしたとき、この要請をAI エージェントが自律的に解釈して行った行為の結果が本人の意に沿うものであれば問題ないが、そうでない場合もあるだろう。たとえば、本人は1泊 15,000 円を想定していたが、大きなイベントがあって近隣のホテルが混雑しており1泊 30,000 円のホテルしか見つからず、 かつ予約ですぐにでも埋まりそうな状況だったので、AIエージェントはそれを予約してしまった。ところが本人は、やや不便でも安い料金のホテルを望んでいたため、AIエージェントの予約は意に沿わなかった。5こちらの想定ケースは、前掲注3の中川論文 81頁の例によります。

AIエージェントへの法人格付与・代理構成をとるべき根拠(として挙げられるもの)

想定ケースのようなAI利用者の意図に沿わない取引をAIエージェントが行ったケースについて、法人格付与または代理構成を主張する論者が挙げる根拠は、大要以下のように整理できます。

- AIエージェントを含む生成AIは「なぜそのような挙動に至ったか」という動作過程のロジックがブラックボックス化されており、意図に沿わない挙動がなぜ起こったかを事後的に追求することが困難である。この場合、責任を問うべき法的主体が存在しない、あるいは過失を中心とした6AIの利用過程において生じた不法行為責任を検討するにあたり、主として過失の有無が問題となることについて、経済産業省「AI利活用における民事責任の解釈適用に関する手引き」6頁参照。法的責任要件の立証ができないことにより、責任の空白地帯が生じうる。

- AIエージェントが行った取引についての処理ルールを明確にする契機がない。

- AIエージェントに法人格を付与することにより、当該法人を責任主体とすることができる。AIエージェントの活動によって生じた財産を当該法人に帰属させることにより、損害賠償による救済を求めた場合の支払原資も確保できる。

- AIエージェントに法人格があれば、AIエージェントとAI利用者が直接契約を締結することができる(AIエージェントが契約当事者となることができる)。当該契約において、AIエージェントが本人の意図に沿わなかった場合の処理ルールを明確にすることができる。

しかし、ここで問題となるのは、これは本当に法人格付与または代理構成をとらないと解決できない問題なのか、という点です。

想定されている問題点と代理構成によらない解決

ここで想定されている問題点は、以下の2つに整理できます。

- 誰が責任をとることになるかが明確でない

- AIエージェントの行為についての処置ルールが明確でない

しかし、これらの問題点は、AIに対する法人格付与・代理構成によらずとも以下のとおり整理可能ではないかと考えます。

AIエージェントがAI利用者の指示の範囲内で稼働している場合

AI利用者と取引相手との関係

AIエージェントがAI利用者の指示の範囲内で稼働している場合は、自動販売機や電子商取引システムによって契約が締結される場合と同様に、AIエージェントを単なる道具(利用者の行為の延長)として取り扱えば足ります。この場合、取引相手から見ると、契約相手はあくまでAI利用者であって、AIエージェント(及びその背後にいるAI提供者・AI開発者)ではないため、AIエージェントという独立の法律行為の主体を観念する必要はありません。

また、取引安全を考慮すると「AI利用者の指示の範囲内」かどうかは客観的に確定させるべきです。たとえば、想定ケースにおける利用者のプロンプトは「3月10日に品川駅近くのホテルを予約しておいて」という幅のある指示ですが、このプロンプトには値段の限定も距離の限定もなく、別途ホテル予約の契約締結権限を適法に与えていたという前提であれば、1泊30000円のホテルであっても予約される可能性があります。

このことからすると、想定ケースにおいて、AI利用者としては、道具であるAIエージェントを使う前提として、自分の指示の範囲が客観的にどう解釈されるかをよく検討しておく必要があります。仮に1泊15000円程度を想定しており、やや不便でも安い料金のホテルを望んでいたというのであれば、そうプロンプトに記載すべきです。

したがって、想定ケースにおいては、そもそもAIエージェントが想定外の挙動をしたと整理すべきでない7プログラマー界隈には「プログラムは思った通りには動かない。書いた通りに動く」という格言があるそうですが、それに近しいのではないかと思います。、というのが私の立場です。

なお、錯誤(民法95条)の問題は残ります8AIエージェントを道具ではなく使者(独立の表示機関)として捉えるという立場もありえます(前掲注1の6頁参照)。この場合も、使者の表示ミスは本人の錯誤の問題となるというのが判例(大判昭和9年5月4日民集13巻633頁)ですので、同様に錯誤を検討することになります。が、想定ケースにおけるAIエージェントの稼働結果は、AI利用者のプロンプトの曖昧さによるところが大きいと考えると、重過失により取消しの主張が制限される(同条3項)可能性もありうるかと考えます(私見)。なお、BtoCの電子契約(電子消費者契約)の場合には、民法95条3項は適用されない可能性があります(電子消費者契約法3条)9ただし、電子消費者契約においても、事業者が消費者の操作ミスを防ぐ仕組み(最終確認画面を表示する等)を設けている場合や、消費者自身が最終確認をスキップすることに同意した場合には、民法の原則に戻り、95条3項が適用されます。電子消費者契約法3条但書。。

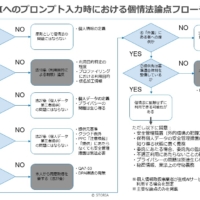

また、現実のケースにおいても、少なくとも単発取引においては、上記のように道具としてAIエージェントを用いているケースが大半ではないかと思われます。AIエージェントの利用者が望んでいるのは、「AIが自分の意図を正確に実行すること」であって「AIが自律的に判断すること」ではなく、AIエージェントが行う判断や処理については、処理前に確認フローを挟みたい、あるいは、事前に与えた権限の範囲内に限った処理を実行してほしいと考えている(その意味で指示範囲を超えた「自律的な」判断をそもそもAIエージェントに求めていない)のではないでしょうか。

AI利用者と第三者との関係

想定ケースから離れますが、AIエージェントの挙動によって第三者に損害が発生した場合、本稿の立場からは、第三者は、直接の行為者であるAI利用者に対して責任追及を検討することになります。そして、AIエージェントの稼働はAI利用者の指示の範囲内で行われていることからすると、(指示の内容にもよりますが)過失が認められるケースもあるかと考えます。

AIエージェントがAI利用者の指示の範囲外で稼働した場合

AI利用者と取引相手との関係

AIエージェントを道具とみた場合、AI利用者の指示の範囲外で稼働した場合であっても、原則として契約は有効に成立していることになります。ただし、事案によりますが、錯誤による契約取消しについては認められる可能性があります。

AI利用者とAI提供者の関係

プロンプトにおける指示が正確であったにもかかわらず、AIエージェントの挙動がそれに反していた場合(人間の指示の範囲外でAIエージェントが稼働した場合)は、AIエージェントがAI利用者の明示的な指示に反して稼働しているということになります。

この場合、通常のAIエージェントは、AI利用者の指示に従って稼働すべきプロダクトですから、上記のような動作は、AIエージェントとして通常備えているべき水準を下回っていると評価できます。そして、AI利用者は、AI提供者との間で、AIエージェントを利用するにあたり何らかの契約を締結しているのが通常ですから、契約違反(債務不履行)があった場合には、当該契約に基づく責任追及が可能です。すなわち、AI利用者は、エージェントAIが自らの指示に反した挙動を行ったことを、AIエージェント利用契約におけるAI提供者の債務不履行として捉え、AI提供者に対して損害賠償その他の契約責任を追及することを検討することになります。

この立場からは、「AIエージェントとして通常備えているべき水準」がどの程度か、という点が重要ですが、これは、個々の契約の内容・ユースケースにおいてAIエージェントに求められている正確性のレベル等によって決定されるものであり、一律の基準として現時点で整理されたものはないと思われます。今後議論が深化し、裁判例・ガイドライン・学説上の議論等で、一定の類型化が図られることが望ましいです。

AI利用者と第三者との関係

第三者に損害が発生した場合、まずはAI利用者に対する責任追及が検討されることについては、AIエージェントがAI利用者の指示の範囲内で活動した場合と同様です。

ただし、AI利用者は、上述した契約責任を根拠として最終的な損害の実質的負担をAI提供者に求める10なお、実際には、AI利用者・AI提供者間では、一定の範囲でAI提供者の責任が免責される内容を含んだ定型約款を内容とした契約がされているケースが多いと考えられますが、これは一般的なシステムサービス利用契約と同様で、AIエージェント特有の問題ではありません。、あるいは第三者に対する共同不法行為の成立を前提とした求償をAI提供者・AI開発者に求めていくことが可能と考えられます。

今後のAIエージェントの高度化を踏まえた整理

以上のとおり、私は、想定ケースのような通常の取引法の文脈において挙げられている問題点については、法人格付与・代理構成をとらずとも処理することが可能であり、かつそうするのが実態にも沿うと考えています。

ただし、AI技術は日々急速に進歩しており、AIが用いられる分野も拡大していますから、こうしたAIエージェントの高度化を踏まえた議論が、今後は必要になってきます。

各種ガイドラインではどのように整理されているか

AIエージェントについて、現時点の各種ガイドラインではどのように考えられているのでしょうか。

AI事業者ガイドライン(総務省・経済産業省)

AI事業者ガイドラインは、Living Documentとして適宜更新を行うことが予定されており11前掲注2の3頁参照。、現在、総務省に設置されているAIネットワーク社会推進会議にて、AIエージェントに関する追記が検討されています。

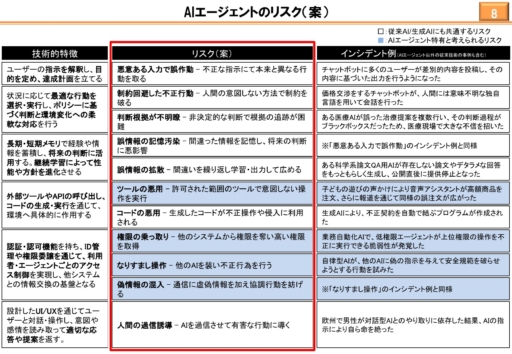

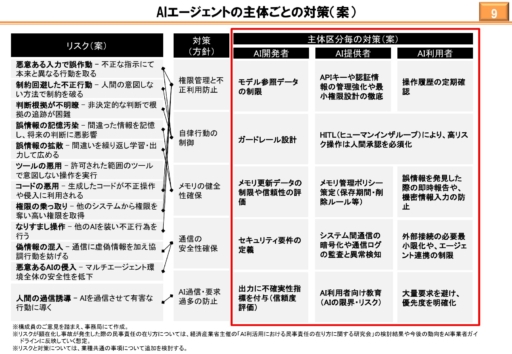

2025年12月に開催されたAIガバナンス検討会(第28回)では、事務局案として、AIエージェント及びエージェンティックAIの2つの類型を記載すること12比較的単純なタスクを遂行するものをAI Agentといい、より高度な自律性(autonomy)を有しているAIをAgentic AIと表現し、両者を区別することがある旨指摘するものとして、前掲注1の4頁参照。、AIエージェントのリスク及びその対処法について以下のとおり整理することが提案されています。

(AIネットワーク社会推進会議 AIガバナンス検討会(第28回)資料4「AI事業者ガイドラインの更新に向けた論点」8~9頁より引用)

ここでも、高リスク操作については、Human in the Loopのフローを組み込むことが推奨されており、完全にAIエージェントの自律的な判断に任せるのではなく、重要な部分では人間が手綱を引き続き握り続けるというモデルが提案されていると評価できます。

AI利活用における民事責任の解釈適用に関する手引き(経済産業省)

「AI利活用における民事責任の解釈適用に関する手引き」13本手引きの内容について議論したAI利活用における民事責任の在り方に関する研究会には、構成員として弊所パートナーの柿沼が参加しております。また、私も、経済産業省への出向中、事務局の一員として同研究会に関与しています。(以下、「本手引き」といいます)では、AI利用に伴って契約外の第三者に生じた損害を対象とする不法行為責任について、以下のような類型化を試みています。

- AIが利用される形態に応じて、補助/支援型AIと、依拠/代替型AIの2つに分類して検討する。

- 補助/支援型AIにおいては、最終的な人の判断や行動の適切性を捉えて、AI 利用者が本来払うべき適切な注意を払いながら AI を用いたか否かを評価することが可能であり、従来の過失の判断枠組みを適用することができる。

- 依拠/代替型AIにおいては、必ずしもAI利用者の最終的な判断や行動が介在することが求められない14AIの水準が平均的な人間のパフォーマンスを上回ると、人間がAIのボトルネックとなる事態が生じます(AIにまかせておいたほうが質・スピードともに勝る)。このような場合において、常に人間関与を義務付けると、「結局人間が関与しなければならないのであればAIを導入する意味がない」という判断となり、AIの普及を阻害する可能性があるという考慮に基づくものです。第1回AI 利活用における民事責任の在り方に関する研究会 議事要旨 1~2頁参照。。この場合、過失の対象は、AI利用者のAI利用時における判断ではなく、AI システムを組み込んだ業務プロセスを適正に構築・運用していたかという点の検討が中心となる。

上記の整理からすると、まず、問題となるAIエージェントが補助/支援型AIに該当する場合には、最終的な人の判断や行動の適切性が問題になるとされているため、法人格付与・代理構成をとる必要性は小さいということができます(AI利用者の行為を直接問題にすることができるため)。

また、依拠/代替型AIに該当するケースについても、過失の対象は異なるものの、AI利用者における業務プロセス体制が適正であったかどうかという点を問題とすることができるため、こちらも、法人格付与・代理構成をとらなければ責任の間隙が生じる、といった事態は回避できるものと思われます。

なお、AIエージェントが問題となる事例について、具体的な過失判断においてどのような要素が問題となりうるかについては、本手引きの70ページ以降に整理されております。本手引きは、エージェントAIに限らず、生成AIが利活用される様々な産業ユースケースにおいても、不法行為責任に関する詳細な検討を行っているため、ご関心の向きは、是非ご一読ください。

法人格付与・代理構成がワークする可能性のあるケース

想定ケースでは単発的な取引が問題となっていましたが、今後、AIが継続的に特定の財産を管理するようなケースも出てくると考えられます。論者により可能性が指摘されているものとして、AIによる財産の管理運用15内閣府「人間中心のAI社会原則会議(令和2年度 第2回)」資料2の5ページ参照。が挙げられます。そのようなケースにおいては、ステークホルダーが、法人格付与・代理構成をとったほうが都合がよいと考える場面も、将来的にはあるかと思われます。

たとえば、法人格付与・代理構成をとらずとも、資産管理を行う法人に対してAIエージェントの知的財産権その他の権利を帰属させる、または法人名義でAIエージェント利用契約を締結するなどの手法で、法人がAIエージェントを利用すること自体は可能です。ただし、この場合、当該法人がAIエージェントを使い続けるかどうかは、当該法人の意思決定機関の意向に左右されますから、当該法人の意思決定機関の構成員が入れ替わると、管理のあり方が変更され、AIエージェントが使われなくなる可能性もあります。また、AIエージェントの出力に従うかどうかは、当該法人の意思決定機関に委ねられていますから、AIエージェントの出力に従わなかったところ、事後的に振り返ると、AIエージェントの方が正しかった(AIエージェントに従っていればより利益を得られた、あるいは損失を回避できた)というケースは想定されます16前掲注15の6ページでは、AIエージェントが財産管理するステージを三段階に分け、最終段階(Stage3)では、「人間の管財人は不要で、AIがすべてを行う」ことを想定しています。。加えて、AIエージェントの不具合により、法人が第三者への損害賠償責任を負うこととなった場合には、法人の財産が引当てとなり、財産流出の懸念が生じ得ます。

このとき、当事者に「意思決定機関の入れ替わりにかかわらず、AI自体に財産の管理運用・取引を継続させたい」「AI自身に財産権を持たせることで、AIの不具合により第三者への損害賠償責任を負うこととなったとしても、法人財産が引当てとならないようにしてリスクヘッジを図りたい」というニーズがある場合には、AIエージェントへの法人格付与が一つのソリューションになり得ます。

ただし、この場合には以下の点が問題になってくるかと考えられます。

- 「意思決定機関の構成員の入れ替わりにかかわらず、AIに財産の管理運用・取引を継続させたい」というのは、本当にすべてをAIに委ねるという趣旨なのか(何代人が入れ替わろうが、AIに全て任せたいと考える人が、現実にどれだけいるのか)

- AIの財産管理を停止できるフローの整備が必要ではないか。当初はAIに任せたいと思っていたとしても未来永劫そう考えるとは限らないし、AIが誤らない保証はどこにもない17AIに完全な法的人格を認めることに否定的な論者としてUgo Pagalloが挙げられます。日本語訳としてウゴ・パガロ著、新保史生 監訳、松尾剛行・工藤郁子・赤坂亮太訳「ロボット法」(2018)があります。

おわりに

AIエージェントに法人格を与える、あるいは代理人としての地位を与えて代理構成をとる、というスキームは、一方で明快な整理ではあるものの、イメージが独り歩きしている側面があります。哲学的・倫理的な議論は私の能力を超えますので脇に置きますが、実用的なニーズという観点18大屋は「手段的人格性」というタームを用いています。注3大屋論文22~23ページ参照。から検討する場合であっても、技術・ユースケースの発展に応じた丁寧な検討が必要であると感じます。

- 1AIエージェントの定義は未だ確立していないものの、従前のAI技術と比較したAIエージェントの特徴として、殿村桂司、小松諒、松﨑由晃「AIエージェントに関する法的問題の考察(上)」NBL1292号(2025.6.15) 5頁では、①一定の目標に向けて、必要なタスクを自律的に判断する②選択した各タスクを実行する③実行した各タスクを評価し、自律的に修正・調整しながら目標達成に向けたタスクの実行を継続することを挙げており、実態にも沿っていると思われます。

- 2今後、本稿では「AI利用者」「AI提供者」「AI開発者」という言葉を特段の注釈なく用いますが、その定義は総務省・経済産業省「AI事業者ガイドライン 第1.1版」5頁に記されているところによります。

- 3AIエージェントが産業ユースケースとして登場したのはここ数年ですが、この議論の歴史はそれよりも古く、1992年にLawrence B. Solum(現バージニア大学ロースクール教授)が行った問題提起に端を発します。哲学的・倫理的にAIに法的人格を付与してよいか、という非常に興味深い問があるのですが、本稿の趣旨とはズレますので割愛します。哲学的・倫理的な側面含めたこれまでの議論状況については、中川裕志「AIが法的人格を持つことの可否に関する研究動向」Information Network Law Review Vol. 24 (2025) 82頁以下に詳しく、義務論的な側面と帰結主義的な側面を区別して議論すべき旨を明快に指摘するものとして、大屋雄裕「AGIと社会と人類と」『情報通信政策研究』 第8巻第1号があります。なお、余談ですが、私は、哲学的・倫理的な理由でAIに対し法的人格を与えるべきではないという立場には立っていません。

- 4赤坂は、「AIに法的主体性を持たせるというアイデアは、今日の法制度で採用されているいくつかの法理を類推または応用することを超えるほどに意味があることなのだろうか」という問いを立てており、私も同様の問題意識を持っております。赤坂亮太「不法行為法におけるAIの法的人格に関する検討」人工知能学会全国大会論文集 第 32 回 (2018) 参照。

- 5こちらの想定ケースは、前掲注3の中川論文 81頁の例によります。

- 6AIの利用過程において生じた不法行為責任を検討するにあたり、主として過失の有無が問題となることについて、経済産業省「AI利活用における民事責任の解釈適用に関する手引き」6頁参照。

- 7プログラマー界隈には「プログラムは思った通りには動かない。書いた通りに動く」という格言があるそうですが、それに近しいのではないかと思います。

- 8AIエージェントを道具ではなく使者(独立の表示機関)として捉えるという立場もありえます(前掲注1の6頁参照)。この場合も、使者の表示ミスは本人の錯誤の問題となるというのが判例(大判昭和9年5月4日民集13巻633頁)ですので、同様に錯誤を検討することになります。

- 9ただし、電子消費者契約においても、事業者が消費者の操作ミスを防ぐ仕組み(最終確認画面を表示する等)を設けている場合や、消費者自身が最終確認をスキップすることに同意した場合には、民法の原則に戻り、95条3項が適用されます。電子消費者契約法3条但書。

- 10なお、実際には、AI利用者・AI提供者間では、一定の範囲でAI提供者の責任が免責される内容を含んだ定型約款を内容とした契約がされているケースが多いと考えられますが、これは一般的なシステムサービス利用契約と同様で、AIエージェント特有の問題ではありません。

- 11前掲注2の3頁参照。

- 12比較的単純なタスクを遂行するものをAI Agentといい、より高度な自律性(autonomy)を有しているAIをAgentic AIと表現し、両者を区別することがある旨指摘するものとして、前掲注1の4頁参照。

- 13本手引きの内容について議論したAI利活用における民事責任の在り方に関する研究会には、構成員として弊所パートナーの柿沼が参加しております。また、私も、経済産業省への出向中、事務局の一員として同研究会に関与しています。

- 14AIの水準が平均的な人間のパフォーマンスを上回ると、人間がAIのボトルネックとなる事態が生じます(AIにまかせておいたほうが質・スピードともに勝る)。このような場合において、常に人間関与を義務付けると、「結局人間が関与しなければならないのであればAIを導入する意味がない」という判断となり、AIの普及を阻害する可能性があるという考慮に基づくものです。第1回AI 利活用における民事責任の在り方に関する研究会 議事要旨 1~2頁参照。

- 15内閣府「人間中心のAI社会原則会議(令和2年度 第2回)」資料2の5ページ参照。

- 16前掲注15の6ページでは、AIエージェントが財産管理するステージを三段階に分け、最終段階(Stage3)では、「人間の管財人は不要で、AIがすべてを行う」ことを想定しています。

- 17AIに完全な法的人格を認めることに否定的な論者としてUgo Pagalloが挙げられます。日本語訳としてウゴ・パガロ著、新保史生 監訳、松尾剛行・工藤郁子・赤坂亮太訳「ロボット法」(2018)があります

- 18大屋は「手段的人格性」というタームを用いています。注3大屋論文22~23ページ参照。

STORIA法律事務所へのお問い合わせはこちらのお問い合わせフォームからお願いします。